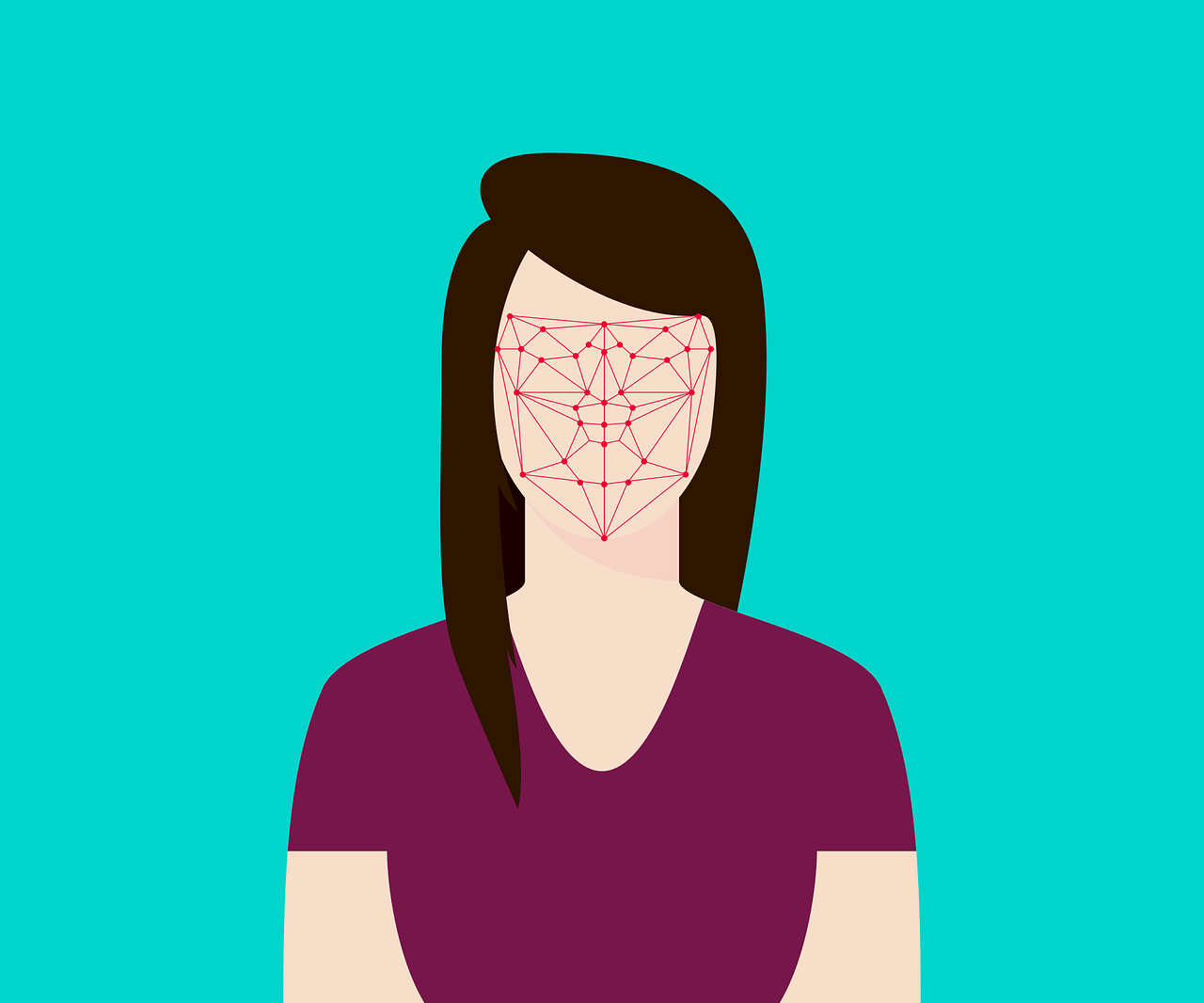

Autor | Eduardo BravoLa mejora de las condiciones de vida para los ciudadanos en las ciudades no se limita solo a cuestiones urbanísticas, ecológicas o de movilidad. También afecta a aspectos como la tutela judicial efectiva, la gestión administrativa de las sanciones y las reclamaciones de las mismas.Según el Eurobarómetro publicado en abril de 2019, más de la mitad de los españoles valora la institución judicial como «bastante mala o muy mala». Solo Croacia, Eslovaquia y Bulgaria tienen una opinión de la justicia peor que España.Para mejorar su funcionamiento, la Administración ha comenzado utilizar la inteligencia artificial para resolver algunos casos sencillos de multas de tráfico, sanciones administrativas e incluso para agilizar la tramitación de ciertos casos judiciales que, por su gran complejidad, requieren analizar grandes volúmenes de información.Con ese objetivo, el Consejo Superior del Poder Judicial firmó en 2017 un convenio con la secretaría de Estado para la Sociedad de la Información y la Agencia Digital, para que la administración de justicia española utilice la inteligencia artificial para consultar de forma rápida y efectiva la jurisprudencia o los sumarios complejos. Gracias a las Tecnologías del Lenguaje, el sistema analiza cientos o miles de documentos y los interpreta como haría un humano, para así localizar los datos que resulten pertinentes para el caso concreto.Microsoft, por su parte, está desarrollando tecnologías para facilitar la labor de los jueces. Un campo que puede proporcionar un importante ahorro a nivel de gestión es el de la Comprensión de Lectura Automatizada o MRC, por sus siglas en inglés. La firma estadounidense ya trabaja con esta tecnología acceder a bibliografía legal en busca de precedentes o casos concretos, y de acuerdo con Kirk Arthur, Sr. Director de la división Gobierno e Industria, "aunque todavía queda mucho por hacer, la MRC promete mejorar enormemente el tiempo que requiere un juez para revisar las leyes y emitir un veredicto".Parte de la desconfianza que genera la justicia entre los ciudadanos radica en la presunta falta de imparcialidad de los magistrados por el hecho de que, en toda decisión jurídica, hay un elemento humano que puede poner en riesgo el análisis objetivo de los hechos. Aprovechando esa situación, en países de tradición jurídica anglosajona han empezado a proliferar empresas que emplean la inteligencia artificial para analizar las resoluciones dictadas por un mismo juez y determinar así un patrón sobre los criterios que sigue a la hora de juzgar.«Instincts are good. Foresight is better» o lo que es lo mismo, «Las corazonadas son buenas pero la previsión es mejor» es el eslogan de Blue J Legal, empresa que dice ser capaz de «predecir con precisión los resultados del tribunal». Un paso más allá va Premonition, cuyo reclamo es poder averiguar «cuáles son los abogados que ganan casos y frente a qué jueces» pues, qué duda cabe, también es importante conocer la estrategia que acostumbran a seguir los letrados de la otra parte.Esta desconfianza por el posible error humano hace que sean muchas las personas que ven en la inteligencia artificial la solución para lograr una justicia aséptica, eficaz y equitativa. Si juzgaran máquinas, razonan, no habrá margen de error. El problema surge cuando se olvida que los algoritmos no son ajenos al componente humano. Desde el momento en que son las personas las encargadas de programar la inteligencia artificial, esta puede estar contaminada de esos mismos sesgos cognitivos.Ejemplo de esa situación es lo sucedido en Estados Unidos con COMPAS (acrónimo de Correctional Offender Management Profiling for Alternative Sanctions), un sistema de inteligencia artificial empleado en la administración de justicia que, a la hora de establecer la condena, no solo valora los hechos referentes a la vida del acusado, sino también datos relativos a su lugar de nacimiento, barrio en el que habita o los antecedentes de sus familiares. Una situación que ha provocado que aquellas personas que residen en barrios conflictivos o cuyos familiares tengan historiales violentos hayan recibido mayores penas por los mismos hechos que otras personas en diferente situación.Al mismo tiempo, proteger toda esa información tiene una importancia crítica, especialmente en países que por ley protegen la identidad de los presuntos delincuentes hasta que se ha iniciado un proceso o se ha declarado su culpabilidad. Por ello, Microsoft, como cualquier otra compañía debe invertir en la protección de sus servicios, pero también respetar una serie de normas que puede variar sustancialmente en cada país. En el caso europeo, el despliegue de este tipo de tecnologías en el futuro implicaría el respeto a normativas como la GDPR.Ante semejantes experiencias, no son pocas las voces que señalan que todavía es pronto para confiar a la inteligencia artificial las decisiones relacionadas con la justicia efectiva. Por eso, en la actualidad apenas se emplea para la imposición de sanciones administrativas en las que haya poco margen valorativo. En el caso de España, por ejemplo, drones que trabajan con algoritmos y machine learning están siendo empleados por la Dirección General de Tráfico para detectar infracciones al volante como utilizar el móvil, no llevar puesto el cinturón de seguridad, no respetar las señales de tráfico o circular por zonas prohibidas. Solo es una pequeña muestra del futuro que nos espera.Imágenes | Sang Hyun Cho, Succo, NakNakNak, Gerd Altmann

Cómo Valencia y Tallin utilizan el emprendimiento para mitigar desastres

home

home